ChatGPTとは、OpenAIが開発した自動言語生成機能を持つチャットボットです。ユーザーが指示や質問を入力すると、自動でテキストを作成してくれる画期的なサービスとして、話題になっていますよね。

ChatGPTを使用するうえで気を付けなければいけないのは、セキュリティに関して不安がある点です。機密情報の漏洩や個人情報の流出など、大きなトラブルを引き起こす可能性があります。適切に活用すれば、深刻に考えすぎる必要はありません。これから、ChatGPTにおいて情報漏洩を防ぐ方法や、企業の機密情報を守る手段を説明しますので、ぜひ参考にしてください。

chatGPTの情報漏洩対策について解説

そもそも、どうしてChatGPTを通じて情報漏洩が発生するのでしょうか。ChatGPTのようなAIチャットボットサービスは、常に膨大な量のデータを学習して、進化を続けています。そのデータには、インターネット上に存在する情報だけでなく、ユーザーが入力した内容も含まれるのです。

過去に報告された情報漏洩で大きな話題となったのは、韓国の大手電子部品メーカー「サムスン電子(Samsung)」です。エンジニア社員がChatGPTに社外秘機密プログラムのソースコードをアップロードし、流出する出来事が起きました。一度共有されてしまったデータは簡単に削除することができないことを懸念した同社は、生成AIツールの使用禁止を社内に通達しました。このようなトラブルに向けた対策として、主に次の3つが挙げられます。

●「Chat history & training」機能をオフにする

●社内でChatGPTの利用に関するポリシーを明確にして、従業員に通知する

●セキュリティソフトを導入する

「Chat history & training」は、過去のチャット履歴を残すかを設定するものです。ChatGPTの初期設定では、ログインした状態ですと自動的に入力内容の履歴が保存される設定になっています。

これをオフにすると履歴が残らず、万が一不正ログインされてアカウント情報およびチャット情報が流出しても、外部への情報漏洩を防げます。

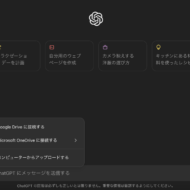

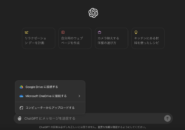

設定変更のやり方は、下記のとおりです。

①ChatGPTにログインし、画面左下のプロフィール欄から「Settings」ページを開く

②「Data controls」をクリックし、「Chat history & training」のプルタブをクリックしてオフにする

また、セキュリティソフトを導入すると、たとえWeb版を多用する環境でも、情報漏洩を防止できます。一例として、「DLP(Data Loss Prevention)」は入力情報を監視するシステムです。

社外秘の情報をコピペしようとする場合、DLPが警告を発して、ChatGPT側への送信を阻止します。マルウェアの侵入やフィッシング詐欺対策にも働くソフトなので、企業や組織にとってメリットが大きいと言えます。

chatGPTに機密情報を学習させないようにするためには?

ChatGPTで機密情報の漏洩を避けるため、入力内容を学習させないという選択肢もあります。基本的な方法として、ChatGPTにはWeb版とAPI版があるのですが、API版を使用するようにしましょう。API版ですと、入力した情報が学習データに利用されることはありません。AIが学習するのは、Web版から入力された情報だけです。

仕事現場では、API版からChatGPTにアクセスすることで漏洩リスクを低減できます。さらに、ChatGPTの企業向けプラン「ChatGPT Enterprise」を利用すると、安全性が高まります。このプランに加入すると、ユーザーが入力した情報がAIの学習に使われません。セキュリティ面も高品質なので、保存した履歴から情報が漏れる心配もいらないでしょう。

ChatGPT Enterpriseは有料プランとなり、価格は非公開です。カスタマイズ機能や企業の規模などによって料金は変動します。コストがかかるのは難点ですが、機密情報の管理を重視するなら検討する価値はあります。

チャットGPTに個人情報を入力してしまったけど大丈夫?

前出のとおり、ChatGPTはWeb版で入力した情報を学習する仕組みになっています。私たちが普段アクセスする際、ログインせずにWeb上で使用する場面も多いですが、個人情報の取り扱いには注意が必要です。

個人情報を入力してしまうと、これらの情報が回答として第三者に表示される可能性があります。いつ誰の回答に出力されるか把握することはできないため、非常に危険です。次のような項目は、ChatGPTに入力しないでください。

●氏名

●住所

●電話番号

●メールアドレス

●勤務先

●銀行口座番号

●各種パスワード

●マイナンバー

どうしても当該情報を入力して何か回答を出力させたい場合、匿名で行い、他人に知られても大丈夫な範囲に留めましょう。サイバー攻撃によってChatGPTのデータベースが侵害され、学習した情報や履歴が盗まれるリスクも存在します。また、自分以外の第三者に関するプライバシー情報を入力してしまうこともトラブルの原因となります。事態が悪化すると個人情報保護法違反に問われるかもしれません。

ちなみに、ChatGPTの公式サイトには、個人情報の扱いについて、下記のように説明されています。

「インターネット上の大量のデータは人に関係するものであるため、当社の学習情報には、意図せずに個人情報が含まれる場合があります」

「当社のモデルのトレーニングのために個人情報を積極的に求めることはしません」

まとめ

ChatGPTは、取り扱い方を間違えると、情報漏洩や個人情報の流出などセキュリティ面のリスクがあります。頭で把握していても、指示や質問内容を具体的にするため、つい機密情報や個人情報を入力してしまうケースは誰にでも生じます。サムスン電子のような大企業の流出事故も、決して他人事ではないのです。

もちろん、機密性が高い情報を絶対に入力しなければいいのですが、「Web版を使用しない」「有料プランのChatGPT Enterpriseを活用する」「チャット履歴を保存しない」など、一手間かけるだけでリスクは大幅に減少します。大人数の組織では、ChatGPTの利用ガイドラインを作成し、従業員に周知させることも欠かせません。一度漏洩したら、その情報を削除するのは不可能に近いです。大きなトラブルを避けるため、事前に対策を講じておきましょう。